Los modelos de lenguaje de gran tamaño (LLMs, por sus siglas en inglés) están revolucionando el campo del procesamiento del lenguaje natural, permitiendo que las máquinas comprendan y generen texto con una precisión cada vez más cercana a la de los humanos. Sin embargo, su uso en el sector de la salud presenta desafíos debido a la naturaleza estática de su conocimiento, que rápidamente se vuelve obsoleto en un área en constante evolución como la médica.

En el ámbito de la salud, la información avanza a pasos agigantados. La investigación médica, las prácticas clínicas y las guías de tratamiento se actualizan constantemente, lo que dificulta que los LLM mantengan su relevancia solo con datos preentrenados. Los registros médicos, informes diagnósticos e historiales de pacientes son únicos y complejos, haciendo que confiar exclusivamente en estos modelos para ofrecer recomendaciones personalizadas sea insuficiente.

Las decisiones en salud requieren integrar información de múltiples fuentes, como literatura médica y bases de datos clínicas, lo cual es complicado para los LLM tradicionales que no pueden sintetizar datos de fuentes diversas de manera integral. Esto limita su capacidad de ofrecer información bien fundamentada en aplicaciones sanitarias.

Para superar estos obstáculos y maximizar el potencial de los LLM en la salud, es necesario desarrollar agentes inteligentes que proporcionen apoyo actualizado y personalizado. Estos agentes deben ser capaces de utilizar el conocimiento médico más reciente y los datos individuales de cada paciente.

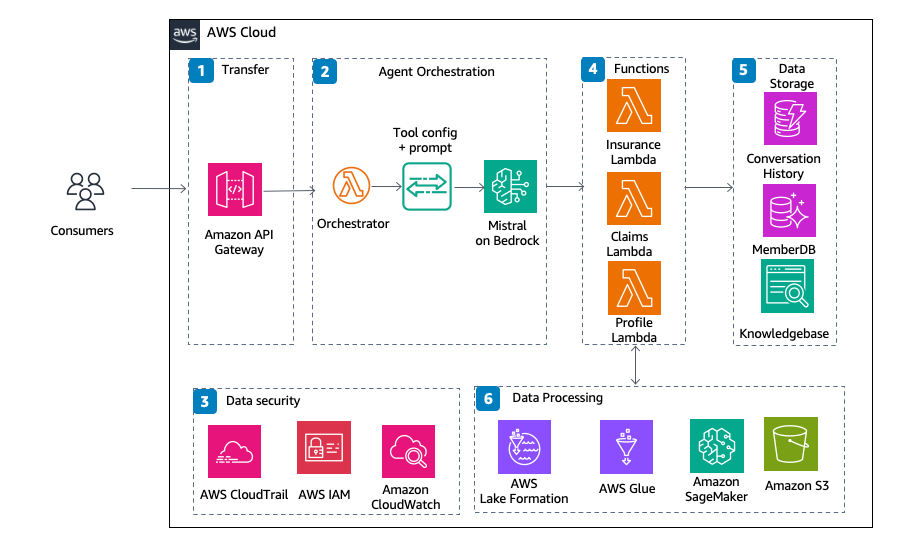

Una solución prometedora es la «función de llamada de LLM», que permite a los modelos de lenguaje interactuar con funciones externas o APIs. Esta habilidad facilita el acceso a fuentes de datos adicionales y capacidades computacionales más allá del conocimiento preentrenado del LLM. Un ejemplo de esto es el modelo Mistral de Amazon Bedrock, el cual incorpora esta función y permite el desarrollo de agentes de salud inteligentes.

Estos agentes pueden desempeñar el papel de asistentes para pacientes, proveedores de salud e investigadores, respondiendo preguntas, interpretando resultados de pruebas y ofreciendo consejos basados en la historia clínica y las condiciones actuales de los pacientes. Para los proveedores de salud, los agentes pueden resumir registros, sugerir diagnósticos y planes de tratamiento, y proporcionar actualizaciones de investigación médica.

Además, estos agentes pueden ayudar en el triage de pacientes y ofrecer recomendaciones de tratamiento personalizadas. A través de una arquitectura avanzada, los LLMs pueden procesar entradas en lenguaje natural, invocar funciones externas y combinar los resultados para ofrecer respuestas completas, todo mientras protegen la privacidad y seguridad de los datos, cumpliendo con normativas como HIPAA y GDPR.

Con el avance de la tecnología, se prevé que las funciones de llamada de LLM evolucionen para incluir capacidades más avanzadas de procesamiento del lenguaje natural, mejor comprensión del contexto y análisis de datos médicos en múltiples formatos. Este progreso representa un gran avance en el sector de la salud, fomentando una atención médica más personalizada y efectiva.